Cara Roblox Bermitra dengan Penegak Hukum

Menyelidiki Potensi Ancaman terhadap Keamanan

- Setiap hari, lebih dari 100 juta pengguna dari segala usia menikmati pengalaman virtual yang aman dan positif di Roblox.

- Kami terus berinovasi dalam sistem keamanan canggih, gabungan AI pintar dan ribuan ahli terlatih.

- Ketika sistem ini mendeteksi tanda-tanda awal aktivitas ilegal, ancaman kekerasan, atau bahaya nyata lainnya, kami melakukan investigasi dan mengambil tindakan tegas, termasuk melaporkannya ke pihak berwenang jika perlu.

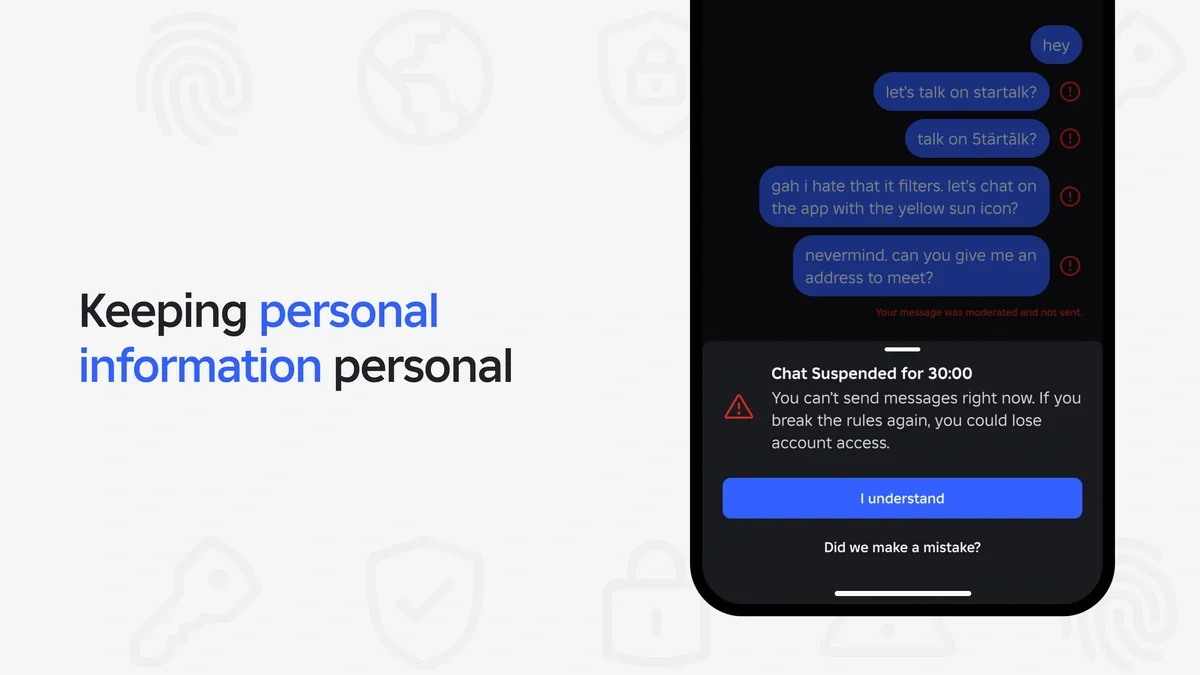

Keamanan adalah landasan utama di Roblox. Sejak awal, platform kami dirancang untuk segala usia, termasuk anak di bawah 13 tahun. Pendekatan kami mencakup infrastruktur keamanan berskala besar dan ribuan orang di seluruh dunia yang fokus menjaga keamanan di platform. Roblox juga merupakan tempat yang sangat berbeda dari bagian Internet lainnya. Kami mewajibkan verifikasi usia untuk chat tanpa filter antar pengguna. Semua chat lainnya, termasuk diskusi publik, difilter secara ketat dan dirancang untuk mencegah berbagi informasi identitas pribadi—termasuk nomor telepon, nama pengguna, dan link ke platform online lainnya.

Sebagai bagian dari sistem moderasi kami yang proaktif, kami memanfaatkan deteksi canggih dan protokol respons cepat untuk melaporkan kemungkinan aktivitas terlarang, ancaman kekerasan, atau bahaya nyata lainnya kepada penegak hukum. Kami berfokus pada inovasi tanpa henti, dan upaya kami dalam meningkatkan keamanan tidak pernah selesai. Kemitraan dengan penegak hukum ini—yang dengan bangga kami soroti saat Roblox berpartisipasi dalam Konferensi Kejahatan Terhadap Anak (CACC) tahunan ke-37 minggu ini—adalah bagian dari upaya kami yang menyeluruh dan beragam untuk membantu menjaga keamanan pengguna.

Langkah-langkah keamanan kami yang ketat akan membuat frustrasi para pelaku kejahatan dan melakukan aksinya di platform lain. Ini adalah hal yang positif—kami tidak ingin mereka ada di Roblox—tetapi sejauh yang kami tahu, banyak pengguna kami yang aktif di beberapa platform dan kami ingin tetap menjaga keamanan mereka bahkan saat mereka tidak menggunakan Roblox. Itulah salah satu alasan kami berkolaborasi dengan penegak hukum di seluruh dunia, sekaligus berusaha melindungi privasi pengguna kami. Dengan membantu mengidentifikasi dan mengacaukan pelaku kejahatan, kami berusaha membantu penegak hukum dalam menghubungkan titik-titik di seluruh platform untuk menyelidiki lebih lanjut dan melakukan intervensi jika diperlukan.

Bekerja Sama dengan Penegak Hukum

Berpartisipasi dalam konferensi penegakan hukum seperti CACC hanyalah salah satu cara kami bermitra dengan penegak hukum untuk membantu menjaga keamanan pengguna Roblox. Melalui penjangkauan global yang kuat, kami telah mengembangkan hubungan yang solid dan jangka panjang dengan penegak hukum di tingkat internasional, federal, negara bagian, dan lokal. Kami berbagi praktik dan pembelajaran terbaik, memberikan panduan yang jelas tentang cara penegak hukum dapat menghubungi kami melalui portal penegak hukum kami, menjelaskan jenis catatan yang bisa diberikan saat ada permintaan hukum yang sah, dan secara aktif mencari masukan penegak hukum tentang masalah keamanan. Kami juga memiliki tim internal yang bekerja sepanjang waktu dan didedikasikan untuk mendukung permintaan penegakan hukum, menyelidiki ancaman keamanan platform, serta meneruskan ancaman serius ke penegak hukum yang tepat.

Kami mengelola saluran komunikasi langsung dengan organisasi, seperti FBI dan National Center for Missing and Exploited Children (NCMEC), untuk segera meneruskan ancaman serius yang kami temukan. Kami secara proaktif melaporkan konten yang berpotensi berbahaya kepada NCMEC, yang menjadi entitas pelaporan khusus bagi penyedia layanan publik dan elektronik terkait kasus dugaan eksploitasi seksual anak. Pada tahun 2024, kami mengirimkan 24.522 laporan ke NCMEC (0,12% dari total 20,3 juta laporan yang dikirimkan ke NCMEC).

Selain itu, selama berkolaborasi dengan NCMEC dan penegak hukum, kami telah mengambil langkah-langkah khusus untuk meningkatkan tindak lanjut dari laporan NCMEC kami, seperti menyertakan informasi penting mengenai faktor yang memperparah atau ancaman yang mendesak. Tindakan ini memudahkan NCMEC dan penegak hukum agar lebih cepat menilai dan menyelidiki laporan kami. Selain itu, kami secara proaktif menyampaikan potensi ancaman keamanan (seperti terorisme, ekstremisme kekerasan, atau ancaman kekerasan individu) melalui integrasi dengan FBI, yang dirancang untuk menangani berbagai laporan dari platform seperti kami. Dalam semua kejadian tersebut, tim internal berdedikasi kami siap 24/7 untuk membantu penegak hukum dalam penyelidikan lebih lanjut.

Kolaborasi yang Lebih Luas

Tantangan ini tidak hanya dialami oleh Roblox. Kami terus berkomunikasi dengan platform lain, lembaga swadaya masyarakat, dan konsorsium akademik/industri untuk bekerja sama mencari solusi dalam menghadapi pelaku kejahatan. Kami telah menjadi anggota aktif Tech Coalition, komunitas perusahaan teknologi yang bekerja sama untuk melindungi anak-anak secara online, sejak tahun 2018. Kami bergabung dengan Lantern sebagai anggota pendiri pada tahun 2023. Program berbagi sinyal lintas platform pertama di dunia ini memungkinkan perusahaan anggota berbagi informasi dan menindak pelaku kejahatan yang berpindah-pindah platform. Kami juga bergabung dengan inisiatif Robust Open Online Safety Tools (ROOST) sebagai mitra pendiri untuk berbagi teknologi keamanan baru yang dapat membantu memajukan industri secara keseluruhan, dimulai dengan pengklasifikasi keamanan suara kami.

Selain organisasi ini, kami berkolaborasi dengan pembuat kebijakan dalam inisiatif, perumusan undang-undang, dan upaya penting lainnya seputar keamanan anak. Kami adalah yang pertama dan satu dari beberapa perusahaan yang mendukung California Age-Appropriate Design Code Act (Undang-Undang Pedoman Rancangan Sesuai Umur California) untuk melindungi informasi pengguna anak-anak dan remaja. Kami juga menandatangani surat dukungan untuk California Senate Bill 933 (SB 933), yang memperbarui undang-undang negara bagian untuk secara tegas melarang materi pelecehan seksual anak yang dibuat oleh AI.

Grup yang Main Hakim Sendiri

Para penegak hukum adalah pihak yang paling tepat untuk menyelidiki potensi kejahatan. Oleh karena itu, kami ingin memastikan bahwa pelanggaran apa pun di Roblox dilaporkan dan ditindaklanjuti melalui saluran yang tepat.

Sayangnya, ada beberapa kasus grup atau individu yang melanggar kebijakan kami untuk menipu pengguna atau melakukan tindakan main hakim sendiri di platform. Meskipun grup ini mungkin tampaknya bertindak demi kepentingan publik, mereka sebenarnya bertindak dengan cara yang dapat membahayakan orang lain, baik di dalam maupun di luar platform kami. Misalnya, upaya mereka dapat membuat pelaku kejahatan tetap berada di platform lebih lama hanya untuk membuat konten media sosial yang lebih sensasional.

Tindakan yang diambil oleh grup yang main hakim sendiri justru dapat meningkatkan risiko lebih banyak pengguna terpapar pada pelaku kejahatan dan menghambat penindakan dari Roblox maupun penegak hukum. Setiap akun, termasuk kelompok atau individu yang bertindak main hakim sendiri, yang ketahuan melanggar kebijakan kami akan diberikan sanksi, mulai dari penghapusan hingga pemblokiran jika diperlukan. Kami memberlakukan kebijakan sesuai dengan Standar Komunitas dan Ketentuan Penggunaankami secara keseluruhan.

Alih-alih bertindak sendiri, kami mengajak komunitas untuk melaporkan perilaku yang tidak pantas langsung ke Roblox atau penegak hukum menggunakan metode pelaporan mudah seperti yang diuraikan di bawah ini.

Metode Pelaporan yang Tepat

Kami mengajak setiap pengguna yang mengetahui terjadinya kejahatan untuk langsung menghubungi penegak hukum setempat. Seperti yang dijelaskan di atas, kami secara rutin bekerja sama dengan penegak hukum, dan ketika mereka menghubungi kami, kami siap berkoordinasi sebaik mungkin. Users can also report potential child sexual exploitation directly to NCMEC’s CyberTipline.

Selain bekerja sama dengan penegak hukum, kami membuat program Pelapor Tepercaya, tempat mitra dekat dan tepercaya dapat melaporkan potensi aktivitas kriminal serius (seperti terorisme, ekstremisme kekerasan, atau eksploitasi anak) kepada kami. Kami segera me-review laporan-laporan ini dan, jika perlu, mengambil tindakan yang sesuai. Kami selalu berupaya memperluas program ini dan menyambut baik upaya dari entitas yang tertarik.

Di platform, kami menyediakan alat pelaporan penyalahgunaan yang canggih yang memungkinkan lebih dari 100 juta pengguna aktif harian kami untuk melaporkan perilaku yang tidak pantas di Roblox untuk di-review dan jika perlu, diselidiki. Kami terus meningkatkan antarmuka ini untuk mempermudah pengguna dalam menyertakan semua informasi yang diperlukan, sehingga tim keamanan kami dapat menilai potensi pelanggaran dengan lebih cepat dan tepat.

Kami tahu pekerjaan penting ini tidak ada habisnya. Kami akan terus mendorong semua pihak untuk meningkatkan keamanan online. Antara lain bekerja dengan pembuat kebijakan terkait undang-undang yang melindungi anak-anak dan remaja, berkolaborasi dengan otoritas publik dan lintas industri untuk berbagi masukan, mendukung penyelidikan penegakan hukum, dan meningkatkan sistem keamanan kami sendiri untuk membantu menjaga keamanan pengguna di Roblox.