安全とマナーをRobloxに広げる

- Robloxは常に幼少ユーザーの保護を念頭に置いて設計されてきましたが、それ以外の年齢層にも対応しているところです。

- テキスト、音声、視覚情報、3Dモデル、コード。RobloxはマルチモーダルAIの活用に成功した特異な立場にあります。

- オープンソース化、パートナーとの連携、法の制定を支持するなど、プラットフォームを越えて安全を目指しています。

安全とマナーはRobloxが始まって以来20年近く、基礎となる考え方です。 安全に関する機能やツール、内容審査能力は常に製品に組み込まれてきました。 新機能を公開する前に、潜在する脅威からコミュニティを守るために何ができるか考えているんです。 新機能の悪用の可能性を前もって検討するなど、安全とマナーを最初から考慮して機能を設計しています。これはイノベーションにつながります。 ポリシー、ツール、システムの精度と効率を最大限に高めるため、最新の研究成果やテクノロジーを常に検討しています。

安全の分野でRobloxは普通でない立場にいます。 プラットフォームは普通なら大人向けに始まり、子ども向けの保護に対応していきます。 一方Robloxは子どもが安心して作り、学べる空間として発展してきました。現在、年齢層の拡大に対応すべき段階に来ています。 さらに審査対象となるコンテンツ量も急激に増加しています。生成AI機能・ツールの実装は多くの人々の制作と交流を容易にしました。 Robloxの使命は10億の人々を希望と配慮でつなぐことです。この挑戦は予期されたものでした。 どのような安全のためのポリシーやツールが必要になるのか判断するため、先を見据えながら拡大し、適応していくのがRobloxです。

安全のための機能やツールは革新的なAIソリューションをベースにしたものです。安全の維持に注力する専門のチームもいます。 AIと人間が協力することで24時間いつでも効率的に大量のコンテンツを処理できるのです。 オンラインの安全に携わる団体との関係も深めていて、業界全体の健全化につながるであろう法を支持することもあります。

AIで安全を促進

この規模のプラットフォームで素早く問題に対処するには、精度と効率の面で業界トップレベルのAIシステムを用意しないといけません。コミュニティは拡大し、ポリシーと基準は進化し、新たな挑戦が立ちふさがります。 今日では190の国々で一日あたり7100万人のアクティブユーザーがいます。 彼らは日々交流しコンテンツを共有します。送信されるメッセージは何十億件に及びます。 クリエーターストアには何百万ものアイテムが売られています。マーケットプレイスには日々新しいアバターやアイテムが追加されていきます。 その数は増えるばかりです。Robloxの規模は広がり、制作・交流のための方法も増えていきますからね。

今日では機械学習、大規模言語モデル、マルチモーダルAIの分野で技術の発展が著しいですが、Robloxもプラットフォームの安全性を高めるため、新ソリューションの活用に積極的です。 AIはテキストチャットやボイスチャット、画像、3Dモデル・メッシュの審査に役立っています。 誰もが制作を手軽に、高速にできるようにするためにもAIを活用しています。

革新を呼ぶマルチモーダルAIシステム

このプラットフォームはテキスト、音声、画像、3Dモデル、コードから成り立っています。 複数種のデータを組み合わせて学習させたマルチモーダルAIはユニモーダルと比べて出力品質・精度で勝ります。Robloxはその恩恵を享受しています。 個別の要素では問題がなくても、コンテンツを組み合わせた結果問題となることもあります(テキストと画像など)。マルチモーダルなシステムならそれを検知できます。 例えば、豚のようなアバターを子どもが使っていても何の問題もありませんが… 「お前とそっくりだな!」とメッセージを送った場合はどうでしょうか。 これはいじめにあたり、ポリシー違反になるかもしれません。

3Dモデルのみで学習させたモデルはアバターを問題なしと判断するでしょう。 テキストのみで学習させたモデルはアバターの文脈を考慮せず、テキストに問題はないと判断します。 テキストと3Dモデルの両方で学習させたモデルだけが、上記のようなケースを高速で検知して報告できます。 マルチモーダルなモデルはまだ使われ始めたばかりですが、近い将来、バーチャル空間を丸ごとモニターして違反報告に対応できる日が来るでしょう。 内部のコード、視覚要素、アバター、コミュニケーションを受け取り、さらなる調査が必要か制裁が下されるべきか判別します。

マルチモーダル技術の活用は著しい成果をもたらしました。音声コミュニケーションによるポリシー違反をほぼリアルタイムで検知できるモデルも生まれています。 安全とマナーを業界に行き渡らせるため、このような技術の進化を共有したいと思います。 実際の取り組みとして、初のオープンソースモデルとなる音声安全チェッカーを公開しています。

大量のコンテンツを審査

重大なポリシー違反を防ぐため、ほとんどのコンテンツは公開される 前に 審査されます。 審査を行いつつ遅滞なくコンテンツを公開できるようにするには、精度だけでなくスピードも要求されます。 革命的なAIソリューションがリアルタイムで問題あるコンテンツを判別して排除する助けになっています。万一公開されてしまった場合も、コンテンツを検出して除去するシステムがあります。強力なユーザー報告システムがその一例です。

繰り返される単純なタスクに関しては、自動審査ツールの精度は人間の内容審査スタッフを上回ることが確認されました。 単純なケースを自動化することで、内容審査スタッフは複雑なタスクに専念できます。綿密な調査と研ぎ澄まされた思考が必要とされる仕事です。 安全に関して、自動化は人の手による審査に代わるものではありません。 内容審査スタッフは機械学習モデルの品質と一貫性を監督・テストできる欠かせない存在です。高品質のラベルデータを作成してシステムを変化に対応させることもできます。 スタッフの手で新たなスラングや略語を識別し、全16の対応言語で頻繁に発生するケースを把握すれば、システムが検知できるよう学習させる際も役立ちます。

高品質の機械学習システムにも間違いはあるので、人間の内容審査スタッフは異議申し立てプロセスに関わります。 スタッフは申し立てを起こした人に対応し、誤りがあったケースに追加の学習が必要であるか判断します。 間違いから学習できるので、システムの精度は徐々に高まるでしょう。そして何より、重大な調査は人の手で行うことになります。過激思想や児童虐待といった危険度の高いケースです。 このようなケースについては、専門の内部チームが特に深刻な問題の調査を担当し、事前に悪意ある存在を識別し排除するため動いています。 彼らは製品チームとも連携しています。Robloxの安全を高めていけるよう、仕事の中で得た知見を提供してくれるのです。

会話の審査

スラングや略語など、Roblox向けに学習させたテキストフィルターがあります。 日々25億のメッセージがRobloxを行き交い、ポリシーに違反する言葉を検出するフィルターを介することになります。 フィルターはあらゆる対応言語の違反を検出します。リアルタイムAIチャット翻訳がリリースされた今、特に重要なことです。

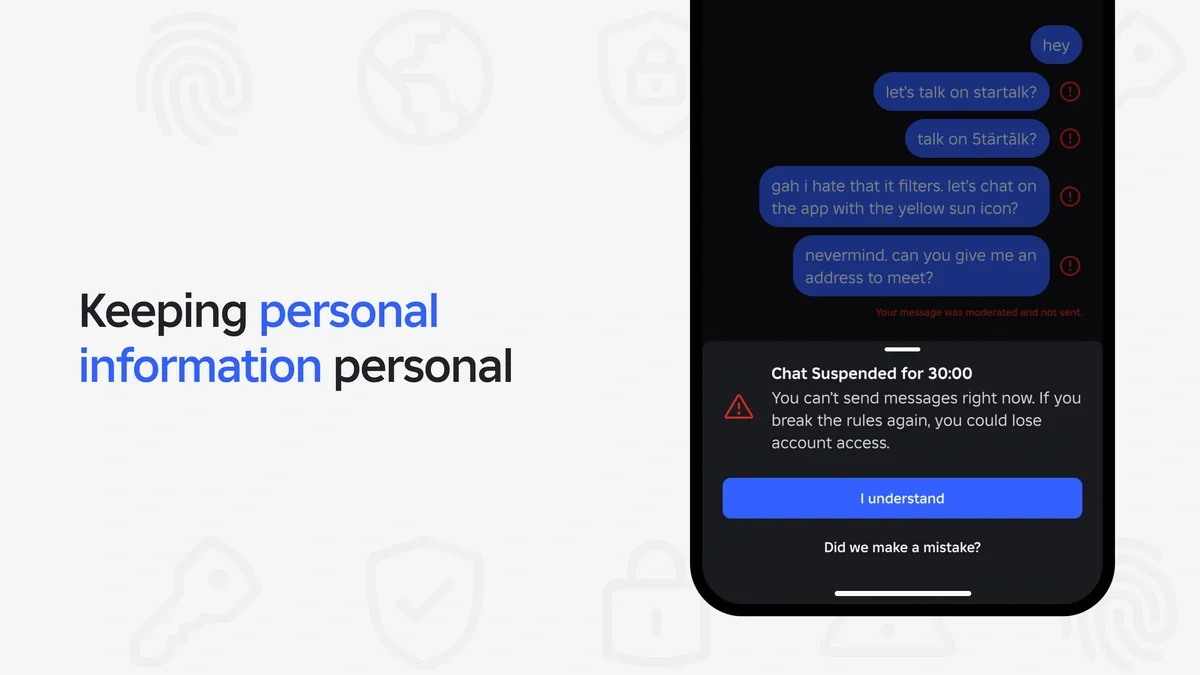

独自のカスタム音声検知システムによる、リアルタイム音声会話審査については先日お伝えした通りです。 ライブ音声を直接AIシステムに送り、たった数秒でポリシー違反を判別させるイノベーションがここにあります。 音声審査システムを実装して以後、ルールを把握しておらず意図せずポリシーに違反してしまう人々も多く見受けられました。 そこで、会話がポリシーに違反していたことを通知するリアルタイム安全システムを開発しました。

このようにまず軽い警告が送られます。言葉遣いに気をつけるよう公園で子どもに言い聞かせるようなものです。 テストの際、この割り込みがマナーの喚起につながり、ポリシーを知ってもらう機会にもなりました。 エンゲージメントデータと比較した結果は良好でした。ツールが悪意を遠ざけ、本当に興味を持っているユーザーの振る舞いを改善できる可能性が高いことが示されています。 1月にリアルタイム審査を英語圏ユーザー向けに開始して以来、音声コミュニケーション関連の通報が53%減少しました(通報数/1日のアクティブユーザー数)。

作品の審査

アバターやアクセサリーのようなアセットには画像認識技術を用います。 ここではアイテムを複数のアングルから撮影した画像を使います。 システムが画像をチェックし、次のステップを決定します。 問題が見当たらない場合、アイテムは承認されます。 明らかにポリシー違反と判定された場合、アイテムは却下されクリエーターに通知されます。 システムが判別できない場合、内容審査スタッフが内容を精査して最終的な判断を下します。

同様の手順がアバター、アクセサリー、コード、フル3Dモデルに用いられています。 フルモデルの場合、コードなどモデルの構成要素もすべてチェックします。 車ならハンドル、シート、タイヤといった部品に分解した上で、そこに適用されたコードも含めすべて検査して問題がないか確認します。 子犬のようなアバターなら、耳も鼻も舌も、問題がないかチェックする必要があります。

他の視点から調べられるようにすることも大事です。 個別の要素に問題がなくても、全体として見ればポリシーに違反していたとしたら? 例えば口ひげとカーキ色のジャケット、赤い腕章。単体で見れば問題がありませんね。 でもこれが組み合わさったアバターの腕章に十字のシンボルがあり、ナチス式の敬礼をしていたら問題ですよね。

ここにRobloxの内部モデルと一般的な画像認識モデルの違いがあります。 後者は普通、現実世界の品々を学習しています。 車や犬は認識できますが、その構成要素は認識できません。 アイテムを細かなパーツに分けて検査できるよう学習・最適化させたのがRobloxのモデルです。

パートナーと協力

皆さんがRobloxで安全に過ごせるようツールを活用していますが、得られた学びを外に共有することも大事だと思っています。 外部でも参考にしていただけるように、初のオープンソースモデルとなる音声安全チェッカーを公開しています。 サードパーティとも提携し、業界が成長する中で得られた知識や成功事例を共有しています。 保護者支援グループ、メンタルヘルス団体、政府機関、法執行機関といった幅広い団体とも密に連携しています。 保護者や政策立案者など、オンラインの安全に関心がある人々から得られる知見は大きいです。 こちらからも、プラットフォームの安全とマナーを保つために使っている技術や得られた学びを共有しています。

最も幼く、守られるべきユーザー層の安全については実績があります。 信頼するフラッガーなどのプログラムでより多くの人々を守れるようにしています。 子どもの安全に関する重要な取り組みや法の制定などについて、政策立案者と協力しています。 例えば、Robloxはカリフォルニア年齢適正デザインコード法を支持した史上初、そして唯一の企業です。子どもを守ることにつながると思い、支持しました。 子どものためになることは皆に広めたいと考えています。 カリフォルニアSB 933法案を支持する書面にも同意しました。これは州法をAI生成による児童ポルノを禁止する形に改正するための法案です。

安全な未来に向けた取り組み

この仕事に終わりはありません。 Robloxの誰もが制作しやすい環境を作りながらも、すでに次世代の安全ツールと機能にも着手しています。 規模を広げ、制作と共有のための新しい手段を提供するとともに、Robloxの内外に向けて安全とマナーのためのまったく新しいソリューションを開発していきます。