Meningkatkan Keamanan dan Kesopanan di Roblox

- Roblox sejak awal dirancang untuk melindungi pengguna kami yang masih di bawah umur, tetapi kini kami beradaptasi dengan makin banyaknya pengguna yang berusia lebih tua.

- Dengan teks, suara, visual, model 3D, dan kode, Roblox berada dalam posisi yang unik untuk meraih kesuksesan dengan solusi AI multimodal.

- Kami sebisa mungkin turut meningkatkan keamanan di seluruh industri melalui sumber terbuka, kolaborasi dengan mitra, atau dukungan untuk perumusan undang-undang.

Keamanan dan kesopanan telah menjadi prinsip Roblox sejak pendiriannya hampir dua dekade lalu. Sejak awal, kami berkomitmen mengintegrasikan fitur dan alat keamanan, serta kapabilitas moderasi ke dalam produk kami. Sebelum meluncurkan fitur baru, kami sudah mulai memikirkan cara melindungi komunitas kami dari potensi bahaya. Proses perancangan fitur untuk menjamin keamanan dan kesopanan sejak dini, termasuk pengujian awal untuk melihat potensi penyalahgunaan fitur, dapat membantu kami berinovasi. Kami terus mengevaluasi riset dan teknologi terkini untuk menjaga agar kebijakan, alat, dan sistem kami tetap seakurat dan seefisien mungkin

Untuk urusan keamanan, Roblox memiliki posisi yang unik. Sebagian besar platform dimulai sebagai tempat untuk orang dewasa dan kini secara retroaktif berupaya melindungi pengguna remaja dan anak-anak. Sementara itu, platform kami dikembangkan sejak awal sebagai lingkungan yang aman bagi anak untuk berkreasi dan belajar, dan kini kami berusaha beradaptasi dengan basis pengguna yang terus berkembang dengan cepat dan bertambah dewasa. Selain itu, volume konten yang kami moderasi juga telah meningkat secara eksponensial berkat fitur dan alat AI generatif baru yang memudahkan lebih banyak pengguna untuk berkreasi dan berkomunikasi di Roblox. Ini bukanlah tantangan tak terduga—misi kami adalah menghubungkan satu miliar orang dengan optimisme dan kesopanan. Kami selalu punya visi ke depan untuk memahami kebijakan dan alat keamanan yang kiranya diperlukan dalam proses kami berkembang dan beradaptasi.

Sebagian besar fitur dan alat keamanan kami didasarkan pada solusi AI inovatif yang dijalankan dengan didampingi tim yang terdiri dari ribuan pakar yang berdedikasi memastikan keamanan platform kami. Perpaduan strategis antara pengalaman manusia dan otomatisasi cerdas sangatlah penting dalam upaya kami meningkatkan volume konten yang kami moderasi sepanjang waktu. Kami juga percaya akan pentingnya memelihara hubungan kemitraan dengan organisasi yang berfokus pada keamanan online, dan jika relevan, kami mendukung perumusan undang-undang yang kami percaya dapat membawa kebaikan bagi seluruh industri.

Meningkatkan Skala secara Aman dengan Keunggulan AI

Skala platform kami yang besar memerlukan sistem AI yang dapat memenuhi atau bahkan melampaui tolok ukur industri mengenai akurasi dan efisiensi. Dengan demikian, kami bisa dengan cepat menanggapi perkembangan komunitas, perubahan kebijakan dan peraturan, serta tantangan baru yang terus muncul. Dewasa ini, lebih dari 71 juta pengguna aktif harian di 190 negara berkomunikasi dan saling membagikan konten di Roblox. Setiap harinya, para pengguna mengirimkan miliaran pesan chat kepada teman mereka di Roblox. Toko Kreator kami memiliki jutaan barang yang dijual—dan kreator kami menambahkan avatar dan item baru di Marketplace setiap harinya. Jumlah ini akan terus bertambah dengan makin berkembangnya kami dan tersedianya cara baru bagi pengguna untuk berkreasi dan berkomunikasi di Roblox.

Seiring dengan industri ini secara luas mengalami perkembangan yang pesat di bidang pembelajaran mesin (ML), model bahasa besar (LLM), dan AI multimodal, kami mencurahkan banyak upaya pada cara-cara memanfaatkan solusi-solusi baru ini guna meningkatkan keamanan Roblox. Solusi AI sudah membantu kami melakukan moderasi chat teks, komunikasi suara imersif, gambar, serta model 3D dan mesh. Kini kami menggunakan banyak teknologi tersebut agar kreasi Roblox bisa menjadi lebih mudah dan cepat bagi komunitas kami.

Berinovasi dengan Sistem AI Multimodal

Pada dasarnya, platform kami menggabungkan teks, suara, gambar, model 3D, dan kode. AI multimodal, yang sistemnya dilatih dengan beberapa tipe data secara bersamaan guna memproduksi hasil yang lebih akurat dan mutakhir daripada sistem unimodal, kini membukakan peluang yang unik bagi Roblox. Sistem multimodal mampu mendeteksi gabungan jenis konten (misalnya, gambar dan teks) yang mungkin memunculkan masalah meskipun unsur-unsurnya secara terpisah tidak bermasalah. Untuk membayangkan cara kerjanya, katakanlah ada anak yang menggunakan avatar berbentuk babi—tidak ada masalah, bukan? Sekarang, bayangkanlah ada orang lain yang mengirimkan pesan chat berbunyi “Ini mirip denganmu! ” Pesan tersebut mungkin melanggar kebijakan kami tentang perundungan.

Model yang hanya dilatih dengan model 3D akan menyetujui avatar tersebut. Di sisi lain, model yang dilatih hanya dengan teks akan menyetujui teks tersebut dan mengabaikan konteks avatarnya. Hanya model yang dilatih dengan teks dan model 3D yang bisa secara cepat mendeteksi dan menandai masalah dalam contoh ini. Saat ini kita berada di fase awal model multimodal ini. Akan tetapi, tidak lama lagi, sistem kami diharapkan bisa menanggapi laporan pelanggaran dengan meninjau seluruh pengalaman virtual. Sistem ini dapat memproses kode, tampilan visual, avatar, dan komunikasi di dalamnya sebagai input, lalu menentukan apakah diperlukan adanya investigasi lanjutan atau konsekuensi.

Kami sudah mencapai kemajuan berarti dengan menggunakan teknik multimodal, misalnya model kami yang bisa mendeteksi pelanggaran kebijakan dalam komunikasi suara mendekati real-time. Kami berniat membagikan kemajuan tersebut jika melihat adanya peluang untuk meningkatkan keamanan dan kesopanan, tidak hanya di Roblox, tetapi juga di seluruh industri. Bahkan, kami membagikan model sumber terbuka perdana kami, sebuah penggolong keamanan suara, kepada seluruh industri ini.

Memoderasi Konten dalam Skala Besar

Di Roblox, kami meninjau hampir semua tipe konten untuk menemukan pelanggaran kebijakan kritis sebelum konten tersebut muncul di platform. Untuk melakukan hal ini tanpa menyebabkan keterlambatan besar bagi pengguna yang akan memublikasikan konten, kami memerlukan kecepatan dan akurasi. Solusi AI mutakhir dapat membantu kami mengambil keputusan yang lebih baik secara real-time untuk membersihkan konten problematik dari Roblox—dan jika ada yang lolos ke platform, kami telah menerapkan sistem yang bisa mengidentifikasi dan menghapus konten tersebut, termasuk sistem pelaporan pengguna kami yang bisa diandalkan.

Kami melihat bahwa akurasi alat moderasi otomatis telah melampaui moderator manusia untuk urusan tugas sederhana yang berulang. Dengan mengotomatiskan kasus-kasus sederhana ini, moderator manusia kami bisa lebih leluasa melakukan tugas yang paling membutuhkan kemampuan mereka, yaitu tugas yang lebih kompleks serta memerlukan pemikiran kritis dan investigasi lebih jauh. Namun, untuk urusan keamanan, kami tahu bahwa otomatisasi tidak bisa sepenuhnya menggantikan peninjauan oleh manusia. Moderator manusia kami sangatlah berguna dalam membantu kami terus mengawasi dan menguji kualitas serta konsistensi model ML kami, dan untuk membuat set data berlabel dengan kualitas tinggi yang dapat memelihara kebaruan sistem kami. Mereka bisa membantu mengidentifikasi slang dan singkatan baru dalam 16 bahasa yang kami dukung, lalu menandai kasus yang sering muncul agar sistem bisa dilatih untuk mengenali kasus serupa.

Kami tahu bahwa sistem ML dengan kualitas tinggi sekalipun masih bisa melakukan kesalahan. Karenanya, kami menempatkan moderator manusia dalam proses pengajuan banding. Moderator membantu kami menangani pihak yang mengajukan banding, dan dapat mengidentifikasi kebutuhan pelatihan lebih lanjut untuk jenis kasus yang salah ditangani. Dengan demikian, sistem kami lama-kelamaan menjadi makin akurat dengan belajar dari kesalahannya.Yang terpenting, manusia akan selalu terlibat dalam investigasi penting yang melibatkan kasus berisiko tinggi, seperti ekstremisme atau bahaya terhadap keselamatan anak. Untuk kasus-kasus demikian, kami memiliki tim internal khusus yang bekerja secara proaktif untuk mengidentifikasi dan menyingkirkan pelaku kejahatan serta menginvestigasi kasus yang sulit di area-area terpenting. Tim ini juga bermitra dengan tim produk kami, dan berbagi informasi yang didapatkan dari pekerjaan mereka untuk terus meningkatkan keamanan platform dan produk kami.

Memoderasi Komunikasi

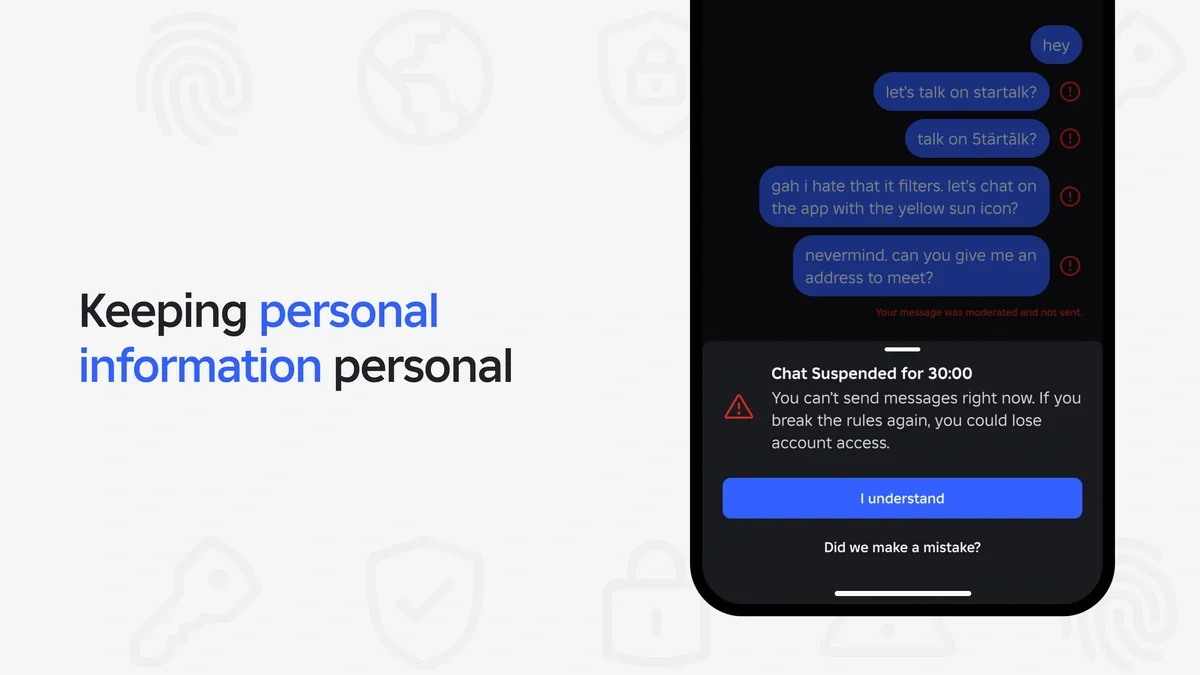

Filter teks kami telah dilatih dengan bahasa khusus Roblox, termasuk slang dan singkatan. Sebanyak 2,5 miliar pesan chat yang dikirimkan setiap harinya di Roblox harus melalui filter yang mampu mendeteksi penggunaan bahasa yang melanggar kebijakan. Filter ini mendeteksi pelanggaran di semua bahasa yang kami dukung. Hal ini sangat penting karena kini kami telah merilis terjemahan chat AI real-time.

Sebelumnya, kami telah membahas cara kami memoderasi komunikasi suara secara real-time melalui sistem deteksi suara khusus yang bersifat internal. Inovasi dalam hal ini adalah ketika ada pesan audio yang dikirim, sistem AI bisa segera menandai audio tersebut sebagai pelanggaran atau bukan—hanya dalam waktu beberapa detik. Ketika memulai pengujian sistem moderasi suara, kami menemukan bahwa dalam banyak kasus, pengguna melanggar kebijakan kami secara tidak sengaja karena mereka belum mengetahui peraturan yang kami terapkan. Kami mengembangkan sistem keamanan real-time yang dapat memberi tahu pengguna ketika pesan suara yang mereka kirimkan melanggar salah satu kebijakan yang kami terapkan.

Pemberitahuan ini merupakan peringatan awal yang halus, mirip dengan ketika kamu diminta untuk berbicara dengan lebih sopan di taman yang dikunjungi banyak anak kecil. Dalam pengujian, intervensi ini terbukti sukses dalam mengingatkan pengguna untuk menghormati pengguna lain dan mengarahkan mereka ke halaman kebijakan kami untuk mengetahui informasi selengkapnya. Ketika dibandingkan dengan data interaksi, hasil pengujian kami terbilang menjanjikan dan mengindikasikan bahwa alat ini cukup efektif dalam menjauhkan pelaku pelanggaran dari platform, sambil tetap mendorong pengguna yang sungguh-sungguh ingin berinteraksi di Roblox untuk memperbaiki perilakunya. Sejak meluncurkan fitur keamanan real-time untuk semua pengguna berbahasa Inggris pada bulan Januari, kami melihat penurunan sebesar 53 persen untuk laporan pelanggaran per pengguna aktif harian terkait dengan komunikasi suara.

Memoderasi Kreasi

Untuk aset visual, yang meliputi avatar dan aksesori avatar, kami menggunakan visi komputer (CV). Salah satu teknik yang kami gunakan melibatkan pengambilan foto item dari berbagai sudut. Kemudian, sistem akan meninjau foto untuk menentukan langkah selanjutnya. Jika sepertinya tidak ada masalah, item itu akan disetujui. Jika ada hal yang jelas melanggar kebijakan, item itu akan diblokir dan kami akan memberi tahu kreator hal yang menurut kami jadi masalah. Jika sistem belum bisa menentukan, item itu akan dikirimkan kepada moderator manusia yang akan memeriksanya dan mengambil keputusan akhir.

Kami melakukan proses yang sama dengan cara yang sedikit berbeda untuk avatar, aksesori, kode, dan model 3D penuh. Untuk model penuh, kami mengambil satu langkah lebih jauh dan memeriksa semua kode serta elemen lain yang membentuk model tersebut. Misalnya, ketika memeriksa sebuah mobil, kami akan memisahkan komponen-komponennya—setir, jok, ban, dan kode di balik semuanya—untuk melihat apakah mobil ini mungkin bermasalah. Jika ada avatar yang tampak seperti anak anjing, kami perlu memeriksa apakah ada masalah di telinga, hidung, dan lidah anak anjing tersebut.

Kami juga perlu memeriksanya dari sudut pandang yang lain. Bagaimana jika komponennya sendiri secara terpisah-pisah tidak bermasalah, tetapi efeknya secara keseluruhan melanggar kebijakan kami? Misalnya, kumis, jaket bahan khaki, dan ban lengan warna merah, secara terpisah memang tidak mengandung masalah. Namun, bayangkanlah jika semua komponen tersebut disatukan menjadi avatar, dengan simbol silang di ban lengan dan satu tangan terangkat seperti tanda penghormatan Nazi. Jelas itu bermasalah.

Dalam hal ini, model internal kami berbeda dengan model CV yang tersedia secara luas. Model-model tersebut biasanya dilatih berdasarkan benda di dunia nyata. Mereka bisa mengenali mobil atau anjing, tetapi tidak bisa mengenali komponen-komponen benda atau hewan tersebut. Model kami telah dilatih dan dioptimalkan untuk menilai item hingga ke komponen terkecilnya.

Berkolaborasi dengan Mitra

Kami menggunakan semua alat yang tersedia demi melindungi pengguna di Roblox. Namun, kami juga sangat ingin membagikan hal yang kami pelajari kepada pihak-pihak di luar Roblox. Bahkan, kami membagikan model sumber terbuka perdana kami, sebuah penggolong keamanan suara, yang dapat digunakan untuk membantu meningkatkan sistem keamanan suara. Kami juga bermitra dengan grup pihak ketiga untuk membagikan wawasan dan praktik terbaik seiring dengan berkembangnya industri ini. Kami juga menjalin dan memelihara hubungan yang akrab dengan berbagai organisasi, termasuk grup advokasi orang tua, organisasi kesehatan mental, lembaga pemerintah, dan badan penegak hukum. Hubungan kemitraan tersebut memberi kami wawasan yang berharga mengenai kekhawatiran orang tua, pembuat kebijakan, dan kelompok lain seputar keamanan di ranah online. Sebagai balasannya, kami membagikan hal-hal yang kami pelajari dan teknologi yang kami gunakan untuk memelihara keamanan dan kesopanan di platform kami.

Selama ini kami selalu mengutamakan keamanan pengguna di bawah umur dan kelompok rentan yang menggunakan platform kami. Kami telah menerapkan sejumlah program, misalnya, Program Pelapor Tepercaya yang dapat membantu kami meningkatkan jangkauan sekaligus perlindungan pengguna di platform kami. Kami berkolaborasi dengan pembuat kebijakan dalam inisiatif, perumusan undang-undang, dan upaya lain yang penting seputar keamanan anak. Contohnya, kami merupakan yang pertama dan satu dari hanya sedikit perusahaan yang mendukung California Age-Appropriate Design Code Act (Undang-Undang Pedoman Rancangan Sesuai Umur California) karena kami percaya bahwa undang-undang ini sangat bermanfaat bagi anak dan remaja. Jika kami yakin bahwa suatu hal dapat mendukung anak dan remaja, kami ingin membagikannya kepada semua pihak. Baru-baru ini, kami menandatangani surat dukungan California Bill SB 933, yang merupakan amendemen undang-undang negara bagian yang secara gamblang melarang material pelecehan seksual anak yang dibuat oleh AI.

Mewujudkan Masa Depan yang Lebih Aman

Ini adalah pekerjaan tanpa garis akhir. Kami tengah mengembangkan generasi alat dan fitur keamanan masa depan, bahkan saat kami juga berupaya mempermudah semua orang untuk berkreasi di Roblox. Seiring dengan perkembangan kami dan bertambahnya cara yang kami sediakan bagi pengguna untuk berkreasi dan berbagi, kami akan terus mengembangkan solusi dan terobosan baru untuk memelihara keamanan dan kesopanan di Roblox—dan bahkan di luar Roblox.